İnsanlık tarihi, teknolojinin gücünü keşfettiği anlarla doludur. Ateşin bulunmasından buhar makinesine, atomun parçalanmasından yapay zekânın yükselişine kadar her adım, medeniyetin seyrini değiştirdi. Ancak bu güç, beraberinde derin ahlaki ikilemleri de getirdi. Nükleer teknoloji ve yapay zekâ, insanlığın karşılaştığı en büyük etik sınavlardan ikisi olarak öne çıkıyor. Peki, bu teknolojiler bize ne öğretti? Ve yapay zekâ çağında, nükleer dönemden aldığımız dersleri uygulayabiliyor muyuz?

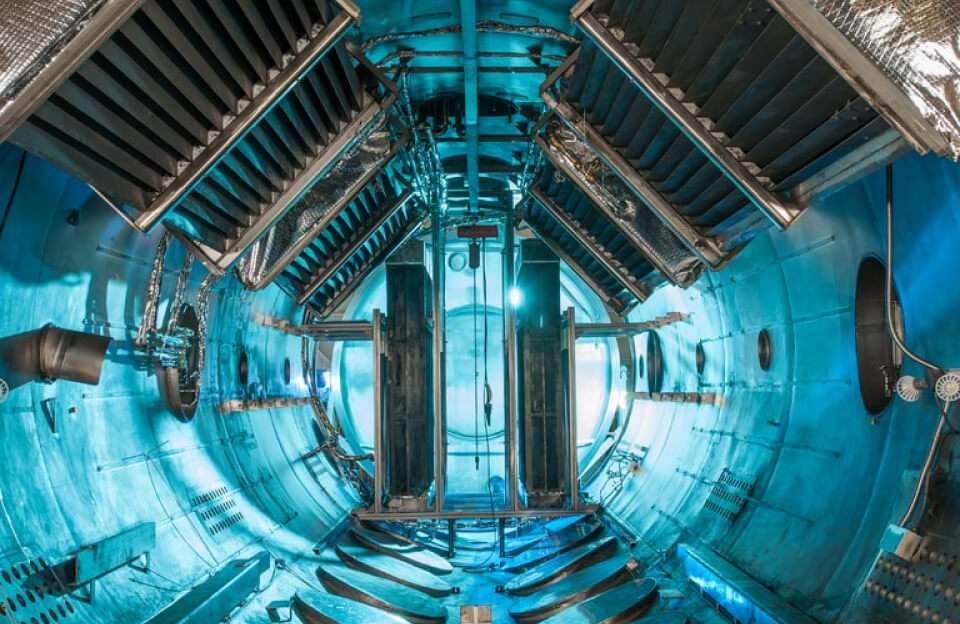

Nükleer Çağın Ahlaki Mirası

20.yüzyılın ortalarında atom bombasının keşfi, insanlığa eşi görülmemiş bir yıkım gücü verdi. Hiroşima ve Nagazaki’de yaşanan trajediler, teknolojinin kontrolsüz kullanımının nelere yol açabileceğini gösterdi. Nükleer silahlar, uluslararası diplomasiyi şekillendirdi; Soğuk Savaş döneminde “karşılıklı garantili yıkım” (MAD) doktrini, insanlığı bir denge politikasına mahkûm etti.

Bu süreçte ortaya çıkan temel soru şuydu: “Gücümüzün sınırlarını nasıl belirleyeceğiz?” Nükleer silahların yayılmasını engellemek için NPT (Nükleer Silahların Yayılmasını Önleme Antlaşması) gibi uluslararası anlaşmalar imzalandı, ancak bugün bile nükleer tehdit tam olarak ortadan kalkmış değil.

Yapay Zekâ: Yeni Bir Etik Sınama

Yapay zekâ, insanlığın teknolojiyle olan serüveninde çığır açıcı bir gelişme olarak karşımıza çıkmaktadır. Ancak bu gelişme, beraberinde çok ciddi etik, sosyal ve insani sorunlar da getirmektedir. Her ne kadar yaşamı kolaylaştırma vaadiyle geliştirilmiş olsa da, yapay zekânın kontrolsüz ve sınırları net çizilmemiş bir şekilde yaygınlaşması, insanlık için tehlikeli sonuçlar doğurma potansiyeli taşımaktadır.

Yapay zekânın insanlık üzerindeki en ciddi etkilerinden biri, iş gücü piyasasında yarattığı sarsıntıdır. Otomasyon ve yapay zekâ destekli sistemlerin hızla yayılması, birçok mesleği tehdit etmektedir. Özellikle üretim, ulaşım, çağrı merkezi, finans ve lojistik gibi sektörlerde çalışan milyonlarca insan, işlerini makineler ve algoritmalara kaptırma riskiyle karşı karşıyadır. Bu durum, sadece ekonomik bir mesele değil, aynı zamanda toplumsal eşitsizlikleri artıran ve sosyal huzursuzluğu tetikleyen derin bir etik sorun olarak karşımıza çıkmaktadır. İnsan emeğinin bu denli hızla dışlanması, bireylerin sadece ekonomik değil, aynı zamanda psikolojik ve sosyal olarak da çöküşe sürüklenmesine neden olabilir.

Bir diğer önemli tehdit, kişisel mahremiyetin ve bireysel özgürlüklerin yapay zekâ yoluyla zedelenmesidir. Günümüzde birçok yapay zekâ uygulaması, bireylerin verilerini sürekli toplayarak analiz etmektedir. Bu veriler, kullanıcıların rızası olmadan toplanmakta ve çoğu zaman ne şekilde kullanıldığı bilinmemektedir. Kişisel tercihlerimiz, konum bilgilerimiz, sağlık verilerimiz hatta duygusal tepkilerimiz, yapay zekâ tarafından sınıflandırılmakta ve ticari ya da politik amaçlarla yönlendirilebilmektedir. Bu durum, bireyin öznel bütünlüğünü tehdit ederken, demokratik toplum yapısına da zarar verebilir. İnsanlar artık neyin kendi iradeleriyle neyin algoritmalar tarafından yönlendirildiğini ayırt edemez hale gelebilir.

Yapay zekâ sistemlerinin tarafsız olduğu düşünülse de, aslında bu sistemler geliştirildikleri veriler kadar adildir. Eğer yapay zekâ, önyargılı, eksik veya çarpık verilerle eğitilmişse, ortaya çıkan sonuçlar da ayrımcı ve adaletsiz olabilir. Örneğin işe alım süreçlerinde kullanılan algoritmalar, belli cinsiyetleri, ırkları ya da yaş gruplarını sistematik olarak dışlayabilir. Bu da toplumun zaten kırılgan olan eşitlik dengesini daha da bozabilir. İnsanların algoritmalar karşısında itiraz edememesi ve karar süreçlerine erişememesi, “saydam olmayan adalet” gibi yeni etik sorunları doğurur.

Daha tehlikelisi ise yapay zekânın askeri alandaki kullanımıdır. Otonom silah sistemleri, insan müdahalesi olmadan hedef belirleyip ateş edebilecek kapasitededir. Bu tür teknolojiler, savaşları daha “otomatik” ve “uzaktan yönetilebilir” hale getirse de, insan hayatını değersizleştirir. Bir makinenin, bir insanın yaşayıp yaşamayacağına karar verebilmesi, sadece teknolojik değil, aynı zamanda derin bir ahlaki felakettir. Savaşın sorumluluğunu insanlardan alıp makinelerin üzerine yıkmak, etik hesap verebilirliği ortadan kaldırabilir.

Sosyal medya platformları ve dijital içerik sağlayıcılar tarafından kullanılan yapay zekâ algoritmaları da insan davranışlarını manipüle etme gücüne sahiptir. Bu sistemler, kullanıcıları ekrana daha fazla kilitlemek ve içerikte kalmalarını sağlamak için duygularıyla oynayabilir, onları kutuplaşmaya itebilir ya da yanlış bilgilerle yönlendirebilir. Böylece bireylerin karar alma süreçleri bozulur, toplumsal diyalog zayıflar, ortak gerçeklik algısı ortadan kalkar. Bilgi, doğruluğundan çok dikkat çekiciliğiyle ön plana çıkar ve hakikat, algoritmaların gölgesinde gerçekliğini kaybedebilir.

Son olarak, yapay zekânın yaygınlaşması, insani değerlerin geri plana atılmasına yol açabilir. Empati, sezgi, vicdan gibi insana özgü nitelikler, algoritmaların “verimlilik” hedefi uğruna ikinci plana itilebilir. Bu durum, insanı sadece sayısal verilere indirgemek anlamına gelir. Oysa insan, sadece rasyonel değil, aynı zamanda duygusal ve ahlaki bir varlıktır. Yapay zekânın bu boyutları dikkate almadan insanla rekabet etmesi, insanın anlamını ve değerini sorgulatır hale getirebilir.

Sonuç olarak, yapay zekâ insanlık için büyük fırsatlar sunsa da, etik sorumluluklarla birlikte ele alınmadığında ciddi tehditler de barındırır. Bu nedenle sadece teknolojiyi geliştirmek değil, onu insanlık onuruna uygun şekilde yönlendirmek de bir zorunluluktur. Aksi takdirde, insanlık kendi elleriyle inşa ettiği zekânın altında ezilebilir